AIハッキングとは何か?

AIハッキングとは、サイバー攻撃を強化または自動化するために人工知能を使用することである。AIハッキングにより、脅威者はコードを生成し、システムを分析し、最小限の手作業で防御を回避することができる。

AIモデル、特に大規模言語モデル(LLM)は、攻撃開発をより迅速かつ安価にし、経験の浅いハッカーにもアクセスしやすくしている。その結果、より速く、よりスケーラブルで、多くの場合従来の防御では阻止することが困難な、新しいAI攻撃のセットが生まれる。

AIハッカーとは何か?

AIハッカーとは、人工知能を使用してサイバー攻撃を自動化、強化、拡大する脅威行為者のことである。AIハッカーは、機械学習モデル、ジェネレーティブAI、および自律エージェントを使用して、セキュリティ制御を回避し、非常に説得力のあるフィッシング攻撃を作成し、ソフトウェアの脆弱性を大規模に悪用します。

これらの攻撃者には、AIツールを使用する人間のオペレーターと、人間の入力を最小限に抑えてタスクを実行する半自律システムの両方が含まれる。AIを使用する人間の攻撃者は、犯罪者、スクリプト・キディ、ハクティビスト、国家行為者など、現実世界の個人であり、攻撃能力を高めるためにAIモデルを使用する。

自律型ハッキング・エージェントは、最小限の監視で偵察、ペイロード生成、回避などのタスクを連鎖させることができるAI主導のワークフローです。これらのエージェントは、人間が定義した目標に誘導されつつも、起動後は半独立的に動作し、手動ツールよりも効率的に多段階の攻撃を実行することができます。

AIはサイバー犯罪にどう使われるか?

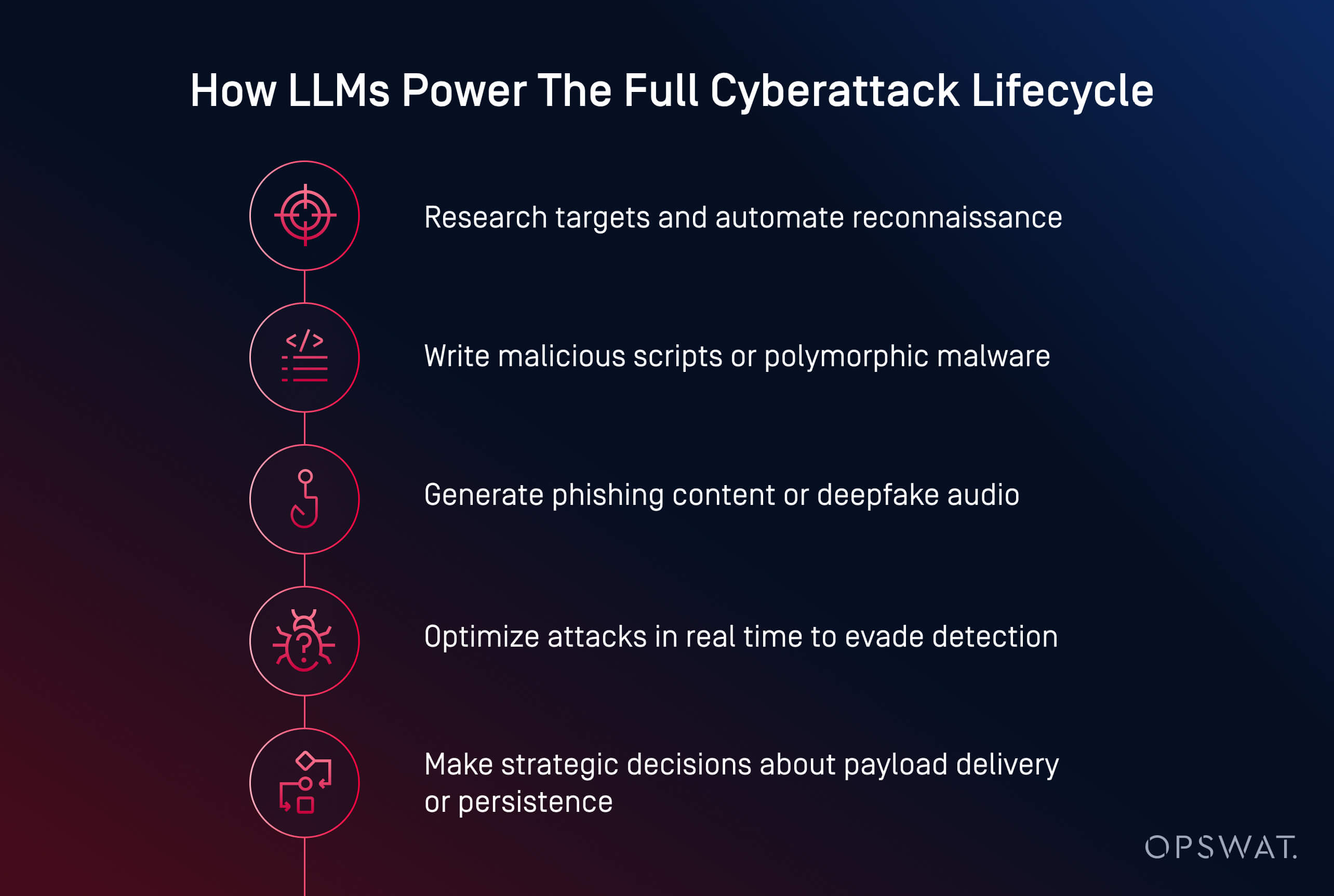

AI脅威の主体は現在、より速く、より賢く、より適応性の高いサイバー攻撃を仕掛けるために人工知能を利用している。マルウェアの作成からフィッシングの自動化まで、AIはサイバー犯罪をスケーラブルなオペレーションに変えつつある。AIは現在、悪意のあるコードを生成し、説得力のあるフィッシング・コンテンツを作成し、攻撃者を完全な攻撃チェーンに導くことさえできる。

サイバー犯罪者はいくつかの中核的な分野でAIを利用している:

- ペイロードの生成:HackerGPTやWormGPTのようなツールは、難読化されたマルウェアを作成し、回避戦術を自動化し、スクリプトを実行ファイルに変換することができる。これらは生成的AI攻撃の例であり、モデルが自律的に意思決定を行うAIエージェントのサイバー攻撃でよく見られます。

- ソーシャル・エンジニアリングAIはリアルなフィッシングメールを作成し、声のクローンを作成し、被害者をより効果的に操るためにディープフェイクを生成する。

- 偵察と計画:AIがターゲット調査、インフラマッピング、脆弱性特定をスピードアップ。

- 大規模な自動化: 攻撃者はAIを利用し、人為的な介入を最小限に抑えて多段階のキャンペーンを展開する。

ポネモン研究所によると、AIはすでにランサムウェア・キャンペーンやフィッシング攻撃に利用されており、2023年の侵害事件では、クレデンシャルの盗難や300以上の小売店舗の強制シャットダウンなど、業務に大きな混乱をもたらした。

いくつかの新たなパターンが、脅威の状況を再構築している:

- サイバー攻撃の民主化:攻撃用に微調整されたLLaMAのようなオープンソースモデルが、ローカルコンピューティングパワーさえあれば誰でも利用できるようになった。

- より低い参入障壁:かつては専門的なスキルが必要だったことが、簡単なプロンプトと数回のクリックでできるようになりました。

- 回避成功率の向上:AIによって生成されたマルウェアは、静的検知、サンドボックス、さらには動的解析から隠れることに長けています。

- マルウェア・アズ・ア・サービス(MaaS)モデル:サイバー犯罪者はAI機能をサブスクリプションベースのキットにバンドルし、複雑な攻撃を大規模に実行しやすくしている。

- 現実世界の侵害におけるAIの使用: Ponemon Instituteの報告によると、攻撃者はすでにAIを使用してランサムウェアの標的を自動化しており、その中には主要な業務の停止を余儀なくされたインシデントも含まれている。

AIを活用したフィッシングとソーシャル・エンジニアリング

AIを活用したフィッシングやソーシャル・エンジニアリングは、従来の詐欺を検知しにくいスケーラブルでパーソナライズされた攻撃へと変貌させている。脅威の主体は現在、生成モデルを使用して、信憑性の高い電子メールを作成し、声のクローンを作成し、さらにはターゲットを操作するために偽のビデオ通話を作成します。

従来の詐欺とは異なり、AIが生成するフィッシングメールは洗練され、説得力がある。ChatGPTやWormGPTのようなツールは、社内のコミュニケーション、顧客サービスのアウトリーチ、人事の最新情報を模倣したメッセージを生成する。漏洩したデータと組み合わせることで、これらのメールはパーソナライズされ、成功する可能性が高くなる。

AIはまた、より新しい形のソーシャル・エンジニアリングにも力を与える:

- ボイス・クローニング攻撃は、短い音声サンプルを使って幹部を模倣し、電信送金のような緊急アクションを誘発する。

- ディープフェイク攻撃でビデオ通話や遠隔会議をシミュレートし、高額詐欺を行う

最近のインシデントでは、攻撃者は福利厚生の登録期間中にAIが生成した電子メールを使い、人事を装って認証情報を盗み、従業員の記録にアクセスした。危険は信頼の錯覚にある。電子メールが社内のものに見え、声が聞き覚えのあるものに聞こえ、要求が緊急のものに感じられれば、訓練を受けたスタッフでさえも騙されてしまう可能性がある。

AIによる脆弱性の発見と悪用

AIは、攻撃者がソフトウェアの脆弱性を発見し、悪用する方法を加速させている。かつては手作業で何日もかかっていたプロービングが、偵察とエクスプロイト生成のために訓練された機械学習モデルを使えば、数分でできるようになった。

攻撃者はAIを使用して、一般公開されたシステム全体の脆弱性スキャンを自動化し、脆弱な設定、古いソフトウェア、パッチが適用されていないCVEを特定します。従来のツールとは異なり、AIは暴露のコンテキストを評価し、攻撃者が価値の高いターゲットに優先順位を付けられるようにします。

一般的なAIによる搾取の手口には次のようなものがある:

- ゼロデイ脆弱性を迅速に発見する自動ファジング

- リモート・コード実行や横移動のためのカスタム・スクリプト生成

- パターン学習と確率モデルによって最適化されたパスワードクラッキングと総当たり攻撃

- ノイズを最小限に抑え、リスクの高い資産をネットワーク上でスキャンする偵察ボット

LLaMA、Mistral、またはGemmaのような生成モデルは、システム固有の特徴に基づいて、シェルコードやインジェクション攻撃のようなテーラーメイドのペイロードを生成するように微調整することができ、多くの場合、商用モデルに組み込まれたセーフガードをバイパスすることができる。

その傾向は明らかだ。AIによって、攻撃者はマシンスピードで脆弱性を発見し、対処できるようになる。Ponemon Instituteによると、サイバーセキュリティの専門家の54%が、AIを活用した攻撃の時代における最大の懸念事項として、パッチの適用されていない脆弱性を挙げている。

AI主導のマルウェアとランサムウェア

AIが生成するマルウェアの台頭は、従来の防御だけではもはや不十分であることを意味する。攻撃者は現在、思考し、適応し、回避するツールを持っており、多くの場合、人間の防御者が対応するよりも速い。

AIを活用したランサムウェアやポリモーフィック型マルウェアは、サイバー攻撃の進化を再定義しつつある。攻撃者は現在、静的なペイロードを記述する代わりに、AIを使用してポリモーフィック・マルウェア(検出を回避するために常に変化するコード)を生成しています。

ランサムウェアの脅威も進化している。AIは、暗号化するファイルの選択、システム価値の分析、最適な実行タイミングの決定を支援することができます。これらのモデルは、ジオフェンシング、サンドボックス回避、インメモリ実行を自動化することもできます。

AIによるデータ流出は、検知を回避するために動的に適応する。アルゴリズムは、トラフィックパターンを分析することで、データを圧縮、暗号化し、検出のトリガーを回避してこっそりとデータを抽出することができます。一部のマルウェアエージェントは、侵害された環境内で観察された内容に基づいて、いつ、どこで、どのようにデータを流出させるかを選択するという、戦略的な意思決定を行うようになってきています。

AIによるサイバー攻撃の例

AIによるサイバー攻撃はもはや机上の空論ではなく、データを盗んだり、防御を回避したり、人間になりすましたりするために、すでに大規模に利用されている。

以下の注目すべき3つのカテゴリーの例は、攻撃者がサイバー攻撃で深刻な被害をもたらすのに高度なスキルはもはや必要ないことを示している。AIは攻撃のスピード、規模、ステルス性を高める一方で、参入障壁を低くしている。防御側は、AIが統合されたシステムを積極的にテストし、技術的操作と人為的欺瞞の両方を考慮したセーフガードを導入することで適応しなければならない。

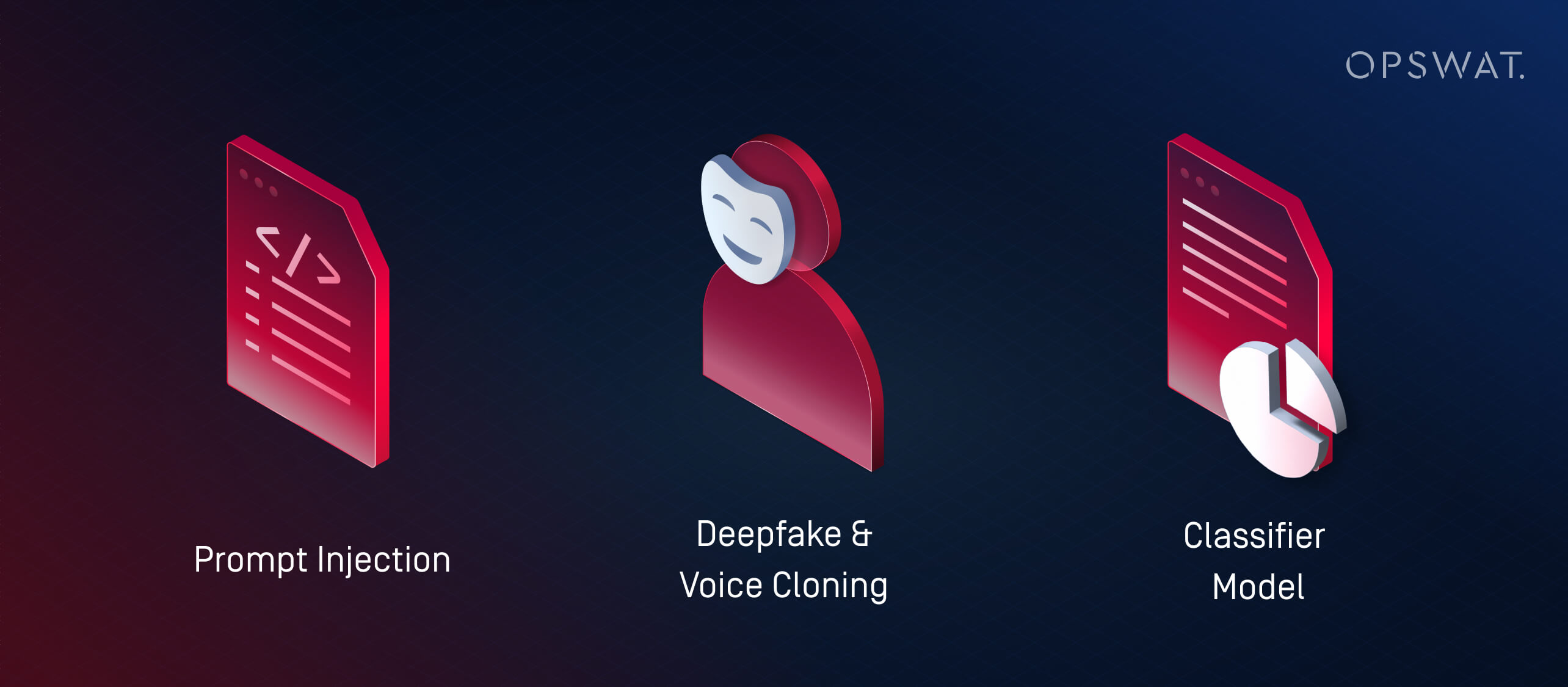

1.プロンプト・インジェクション攻撃とは?

プロンプト・インジェクションは、攻撃者がLLM(大規模言語モデル)の脆弱性を悪用する手法で、意図した動作を上書きするように設計された特別に細工された入力をLLMに送り込む。これらの攻撃は、LLMが命令を解釈し、優先順位をつける方法を悪用するもので、従来のマルウェアはほとんど、あるいはまったく関与していないことが多い。

プロンプト・インジェクションは、AIを使って外部攻撃を仕掛けるのではなく、組織内のAIシステムを知らず知らずのうちに侵害の手先に変えてしまう。LLMがヘルプデスク、チャットボット、ドキュメントプロセッサのようなツールに適切なセーフガードなしに組み込まれた場合、攻撃者はモデルが解釈して実行する隠しコマンドを埋め込むことができます。その結果

- 個人情報や制限されたデータの漏洩

- 意図しないアクションの実行(電子メールの送信、記録の変更など)

- 出力を操作して誤った情報を広めたり、後続行動を誘発したりする。

このようなリスクは、複数のモデルが相互に情報をやり取りするシステムにおいて、より深刻化する。例えば、文書に埋め込まれた悪意のあるプロンプトがAIのサマライザーに影響を与える可能性がある。

AIがビジネス・ワークフローに統合されるにつれ、攻撃者は信頼を損ない、データを抜き取り、内部から意思決定を操作するために、こうしたモデルを標的とすることが増えている。

2.ディープフェイク攻撃とボイスクローン攻撃とは?

ディープフェイク攻撃は、AIが生成した音声や映像を使ってリアルタイムで人になりすます。ソーシャル・エンジニアリングの手口と組み合わされ、これらのツールは詐欺、クレデンシャルの窃盗、システムへの不正アクセスに利用されている。

ボイス・クローニングは特に危険である。録音されたわずか数秒の音声で、脅威行為者はトーン、テンポ、抑揚を模倣した音声を生成することができます。これらのクローン化された音声は、次のような目的で使用されます:

- 緊急の電話中にエグゼクティブやマネージャーになりすます

- 従業員を騙して電信送金やパスワードの再設定をさせる

- 音声認証システムをバイパスする

ディープフェイクは、合成ビデオを生成することで、これをさらに一歩進めます。攻撃者は、機密データを要求するビデオ通話でCEOをシミュレートしたり、偽情報を広めるポリシー変更を「発表」する録画クリップに登場させたりすることができる。 Ponemon Instituteは、攻撃者が企業の福利厚生登録期間中に人事になりすましてAIが生成したメッセージを使用し、クレデンシャルの盗難につながった事例を 報告している。

AIツールがより身近になるにつれ、小規模な脅威行為者でも忠実度の高いなりすましを作成できるようになった。こうした攻撃は、信頼を悪用することで、従来のスパムフィルターやエンドポイント防御を迂回する。

3.分類モデル攻撃(敵対的機械学習)とは何か?

分類器モデル攻撃は、必ずしもマルウェアを書いたりコードを悪用したりすることなく、AIシステムの入力や動作を操作して不正な判断を強要する。 このような手口は、より広範な敵対的機械学習のカテゴリーに分類される。

主な戦略は2つある:

- 回避攻撃:攻撃者は、ウイルス対策エンジンを回避するために無害なファイルを模倣するマルウェアのように、分類器を欺いて誤認させるような入力を細工する。

- ポイズニング攻撃:意図的に歪んだデータでモデルを学習または微調整し、脅威を検出する能力を変更する。

教師ありモデルは、しばしば「オーバーフィット」します。つまり、学習データから特定のパターンを学習し、わずかに逸脱した攻撃を見逃してしまうのです。攻撃者は、WormGPT(攻撃タスク用に微調整されたオープンソースのLLM)のようなツールを使用して、既知の検出境界のすぐ外側にペイロードを作成することにより、これを悪用します。

これはゼロデイ・エクスプロイトの機械学習バージョンだ。

AIハッキングと従来のハッキング:主な違い

AIハッカーは、AIを使用してAIサイバー攻撃を自動化、強化、拡大する。これに対し、従来のハッキングでは、手作業によるスクリプト作成、深い技術的専門知識、多大な時間投資が必要とされることが多い。その根本的な違いは、スピード、スケーラビリティ、アクセシビリティにあります。初心者の攻撃者でも、わずかなプロンプトとコンシューマーグレードのGPUがあれば、高度なAIを駆使したサイバー攻撃を仕掛けることができるようになりました。

アスペクト | AIハッキング | 伝統的なハッキング |

|---|---|---|

スピード | オートメーションで瞬時に | より遅い、手動スクリプト |

スキル要件 | プロンプトベースで、参入障壁は低いが、モデルへのアクセスとチューニングが必要 | 高い。 |

スケーラビリティ | 高 - 多数のターゲットにまたがる多段攻撃をサポートする。 | 人間の時間と労力による制限 |

適応性 | ダイナミック - AIはリアルタイムでペイロードと回避を調整する。 | 静的または半適応スクリプト |

攻撃ベクトル | LLM、ディープフェイク、分類器モデル攻撃、自律エージェント | マルウェア、フィッシング、手動リコン、エクスプロイト |

注意事項 | 予測不可能である可能性があり、人間の監視なしでは意図や文脈を欠く。 | より戦略的なコントロールが可能だが、スピードが遅く、手動 |

AIの悪用と敵対的機械学習

すべてのAI脅威がマルウェアを生成するわけではなく、AIシステムそのものを標的にするものもある。プロンプト・インジェクションやモデル・ポイズニングのような敵対的な機械学習の手口は、分類器を操作したり、検出を回避したり、意思決定を堕落させたりする可能性があります。AIがセキュリティ・ワークフローの中心になるにつれ、こうした攻撃は、堅牢なテストと人間による監視の緊急の必要性を浮き彫りにしている。

AIがマルウェア開発に悪用される可能性:OPSWAT エキスパートによる分析

以前は高度なスキルが必要だったものが、今ではプロンプトと数回のクリックで済むようになった。

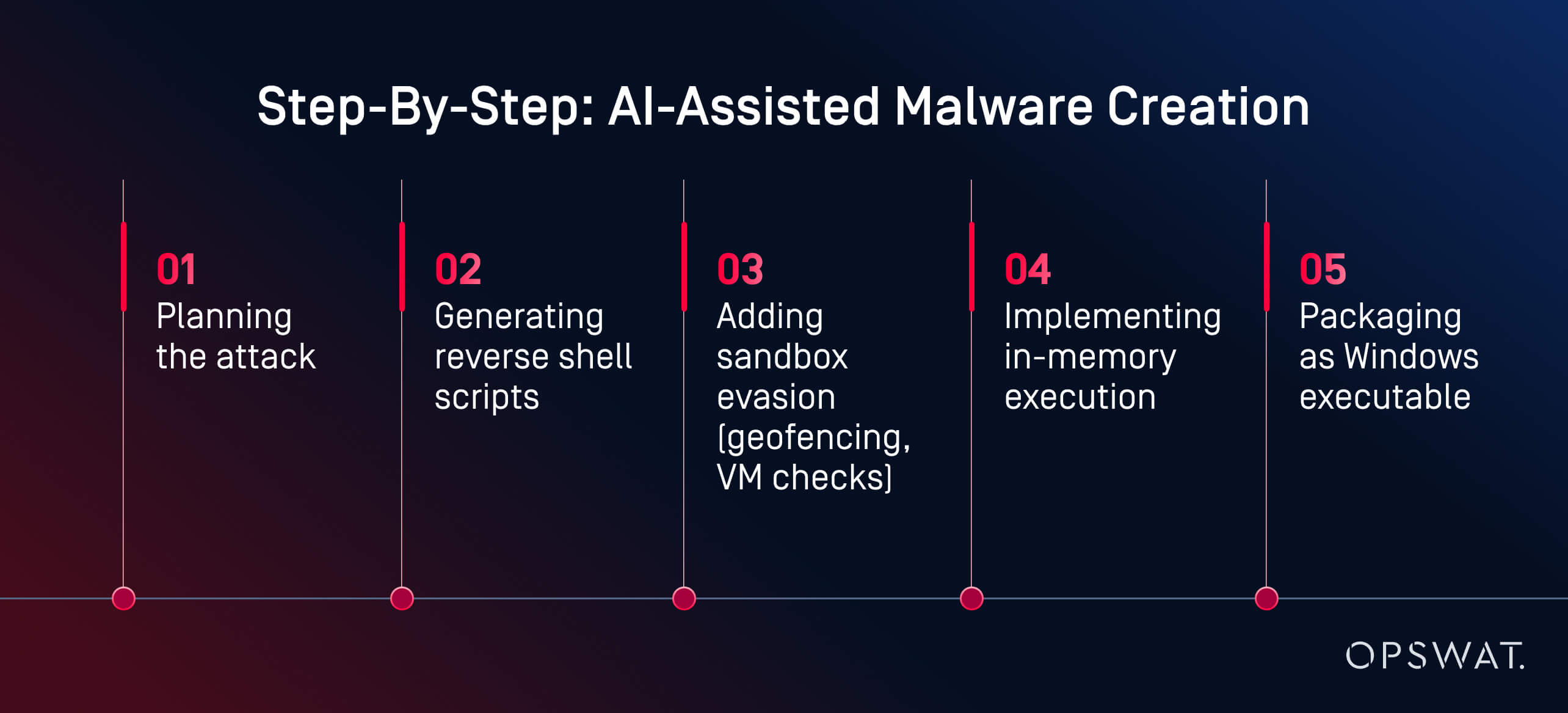

OPSWAT サイバーセキュリティ専門家であるマーティン・カラスは、ライブ実験において、AIツールを使用して、高度なスキルがなくても、迅速かつ安価に回避マルウェアを作成できることを実証した。HackerGPTを使用して、マーティンは2時間以内に完全なマルウェアチェーンを構築しました。HackerGPTのモデルは、すべての段階を通じて彼をガイドしました:

「AIは、計画、難読化、回避、実行というすべての段階を通して私を導いてくれました」とマーティンは説明した。その結果、「...AIが生成したペイロードは、VirusTotalの63のアンチウイルスエンジンのうち60の検出を回避した。行動分析およびサンドボックスも、このペイロードを悪意のあるものとして検出することはできなかった。

これは国民国家ではなかった。ブラックハットのハッカーでもない。コンシューマーグレードのGPUで一般に入手可能なツールを使った、やる気のあるアナリストだった。鍵となるのは? ローカルにホストされた無制限のAIモデルだ。Hugging Faceのようなプラットフォームで利用可能な100万以上のオープンソースモデルにより、攻撃者は膨大なライブラリから選択し、悪意のある目的のために微調整し、監視なしで実行することができます。クラウドベースのサービスとは異なり、ローカルのLLMはセーフガードを無視して攻撃的なタスクを実行するように再プログラムすることができます。

「これはやる気のあるアマチュアが作れるものだ。国家が何をしでかすか想像してみてください」とマーティンは警告した。彼の例は、AIが悪用されることで、サイバー犯罪が熟練した職業から、AIが支援する身近なワークフローへと変貌することを示している。今日、マルウェアの作成はもはやボトルネックではありません。検知は、攻撃者が今手にしているツールよりも速く進化しなければならない。

AIによるサイバー攻撃からいかに身を守るか

よりスマートな検知だけでなく、重層的な防御が必要なのだ。

AIを活用したサイバー攻撃からシステムを守るには、自動化と人間の洞察力、予防と検知を組み合わせた多層的な戦略が必要です。OPSWAT高度な脅威防御プラットフォームのようなAIを活用したサイバーセキュリティ・ソリューションは、防御と検知を統合しています。詳しくはビデオをご覧ください。

AIセキュリティテストとレッドチーム

多くの組織が、LLMの悪用、プロンプト・インジェクション、クラシファイアの回避に対する防御をテストするために、AI支援レッド・チーミングに注目している。これらのシミュレーションは、攻撃者よりも先にAI統合システムの脆弱性を発見するのに役立ちます。

レッドチームは 、敵対的なプロンプト、合成フィッシング、およびAIが生成したペイロードを使用して、システムが回復可能か悪用可能かを評価します。AIセキュリティ・テストには以下も含まれます:

- プロンプト・インジェクションのリスクに対するファジング・モデル

- LLMが操作された入力や連鎖した入力をどのように扱うかの評価

- 回避行動に対する分類器の頑健性のテスト

また、セキュリティ・リーダーたちは、自社のLLMをスキャンして、内部ロジックへの迅速なリーク、幻覚、意図しないアクセスがないかどうかを確認し始めている。これは、生成AIが製品やワークフローに組み込まれるようになるにつれ、極めて重要なステップとなる。

よりスマートな防衛スタック:OPSWATアプローチ

マーティン・カラスは、"AIにはAIで対抗 "するのではなく、多層的でプロアクティブな防御を主張する。OPSWAT ソリューションは、脅威のライフサイクル全体をターゲットとするテクノロジーを組み合わせている:

- Metascan™Multiscanning:複数のアンチウイルスエンジンにファイルを通し、単一のアンチウイルスエンジンシステムでは検出できなかった脅威を検出します。

- MetaDefender :隔離環境でファイルの動作を分析し、静的ルールを回避するAI生成ペイロードさえも検出します

- Deep CDR™ テクノロジー:ファイルを安全なバージョンに再構築し、埋め込まれたエクスプロイトを除去することで脅威を無力化します

このレイヤー・セキュリティ・スタックは、ポリモーフィック脅威、インメモリ・ペイロード、従来のツールをバイパスするディープフェイク・ルアーなど、AIが生成するマルウェアの予測不可能な性質に対抗するために設計されています。各レイヤーは攻撃チェーンの異なる段階をターゲットにしているため、脅威を検知または無力化し、被害が及ぶ前に作戦全体を崩壊させることができる。

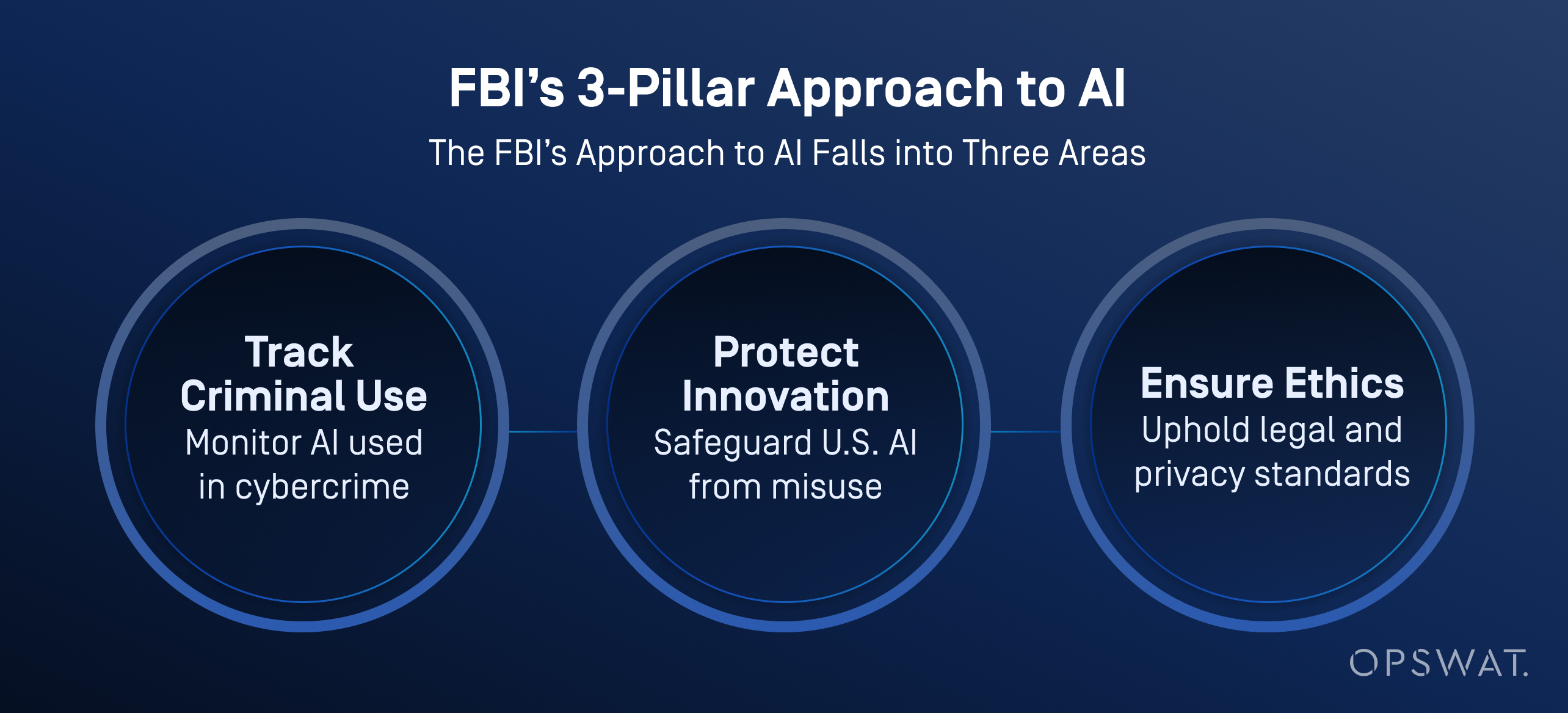

業界のユースケース:FBIはどんなAIを使っているのか?

FBIをはじめとする米国機関は、脅威のトリアージや優先順位付けのためだけでなく、データ分析、ビデオ分析、音声認識の強化のためにも、サイバー防衛業務に人工知能を統合する動きを強めている。

FBIによると、AIは大量のデータを処理し、車両認識、言語識別、音声からテキストへの変換など、捜査の手がかりを生み出すのに役立っている。重要なのは、同局が厳格な人的監視を実施していることだ。AIが生成した出力はすべて、行動を起こす前に訓練を受けた捜査官によって検証されなければならない。

AIは人間の意思決定に取って代わるものではない。FBIは、捜査の結果については常に人間が責任を負い、AIはプライバシー、市民の自由、法的基準を尊重した方法で使用されなければならないと強調している。

組織は準備できているか?

Ponemonの「State of AI Cybersecurity Report(AIサイバーセキュリティの現状)」によると、AIによる脅威が増加しているにもかかわらず、セキュリティ専門家の37%しか、AIによるサイバー攻撃を阻止する準備ができていないと回答している。その多くは、いまだに時代遅れのサイバーリスク管理計画や事後的な検知戦略に頼っている。

前進するためには、4つの重要なステップが必要だ:

- AIを意識した防御ツールの迅速な導入

- 継続的なレッドチームと迅速なリスクテスト

- Multiscanning、CDR、サンドボックスの積極的な活用

- 自動化された調査ツールと共に作業するSOCアナリストのトレーニング

AIはルールを変えた。人間に取って代わるのではなく、自ら考えるようになった攻撃に打ち勝つためのツールを提供するのです。当社のプラットフォームが、ITおよびOT環境におけるファイル、デバイス、データの流れをどのように保護するかをご覧ください。

よくある質問 (FAQ)

AIハッキングとは何か?

AIハッキングとは、大規模言語モデル(LLM)のようなツールを使用してサイバー攻撃を自動化または強化することである。攻撃者がマルウェアを作成し、フィッシング・キャンペーンを展開し、以前よりも迅速かつ容易に防御を回避できるようにする。

AIはサイバー犯罪にどのように利用されているのか?

犯罪者はAIを使ってマルウェアを生成し、フィッシングを自動化し、脆弱性スキャンを高速化している。ダークウェブ・フォーラムで販売されているようなツールの中には、攻撃者が完全な攻撃チェーンを通して歩くことさえできるものもある。

AIハッキングと従来のハッキングの違いは?

従来のハッキングでは、コーディングやツールの使い方、技術的なスキルが必要でした。AIハッキングは、簡単なプロンプトからペイロード、スクリプト、フィッシング・コンテンツを生成するモデルにより、この障壁を軽減します。これらの技術により、攻撃はより速く、よりスケーラブルになり、素人でもアクセスできるようになります。

AIがマルウェア開発に悪用される可能性は?

AIは、ポリモーフィックマルウェア、リバースシェル、サンドボックス回避ペイロードをわずかな入力で生成することができます。OPSWAT ライブデモで示されたように、悪意のないユーザーが、ゲーミングPC上で動作するオープンソースのAIモデルを使用して、2時間以内にほぼゼロデイマルウェアを作成しました。

AIはハッカーに取って代われるか?

まだそうではないが、多くの技術的タスクをこなすことができる。AIがコードを書き、検知を回避し、攻撃を適応させるのに対して、ハッカーは依然としてターゲットとゴールを選んでいる。真のリスクは、AIのスピードによって増幅された人間の攻撃者である。

AIハッカーとは何か?

AIハッカーとは、AIを使ってサイバー攻撃を仕掛けたり、マルウェアを自動化したり、大規模なフィッシング・キャンペーンを実行したりする人や半自律的なシステムのことである。

FBIはどのようなAIを使っているのか?

FBIは、脅威のトリアージ、フォレンジック分析、異常検知、デジタル証拠処理にAIを使用しています。これらのツールは、アナリストの作業負荷を軽減しながら、捜査を自動化し、優先順位の高いケースを浮上させるのに役立ちます。

AIによる攻撃の例とは?

実際にあった事例として、ある企業の福利厚生登録期間中にAIが生成したフィッシング・メールがあった。攻撃者は人事部になりすまして認証情報を盗み出した。また別のケースでは、AIがランサムウェアの標的を自動化し、多国籍ブランドの業務停止を余儀なくさせた。

AIサイバー攻撃とは何か?

AIサイバー攻撃とは、人工知能の助けを借りて開発または実行される脅威である。例としては、AIが生成するフィッシング、ディープフェイクによるなりすまし、プロンプト・インジェクション、分類器回避などがある。これらの攻撃は、従来の防御を回避することが多い。

ハッカーや詐欺師はどのようにAIを使って人々をターゲットにしているのか?

ハッカーはAIを使ってフィッシングメールをパーソナライズし、電話詐欺のために声を複製し、ターゲットを欺くためにディープフェイクビデオを生成する。このような手口は人間の信頼を悪用し、よく訓練されたユーザーでさえ、AIが作り出したリアルな欺瞞に対して脆弱になる。

AIによる攻撃を防ぐには?

レイヤー防御を使う:Multiscanning、サンドボックス、CDR、そして人間主導のレッドチーム。AI攻撃の動きは速い。防御側は、自動化、コンテキスト、スピードが必要だ。